La inteligencia artificial generativa ha abierto nuevas posibilidades para las empresas. Sin embargo, los modelos parten de un conocimiento general y necesitan adaptarse a tareas concretas para aportar valor real. Ahí es donde entra en juego el fine-tuning.

En este artículo explicamos qué es, cómo funciona y cuándo aplicarlo frente a alternativas como prompt engineering o RAG.

Qué es el Fine-Tuning en modelos de IA

El fine-tuning es el proceso de adaptar un modelo previamente entrenado a una tarea o contexto específico utilizando datos propios.

En lugar de construir un modelo desde cero, consiste en ajustar cómo responde para que se alinee mejor con un caso de uso concreto. Esto puede implicar adaptar:

- El comportamiento: formato, tono o estilo de respuesta.

- El dominio: terminología y patrones propios de un sector.

Hoy en día, este ajuste no siempre implica modificar todo el modelo. Existen enfoques más eficientes, conocidos como Parameter-Efficient Fine-Tuning (PEFT), que permiten realizar cambios sobre una pequeña parte de su estructura. Técnicas como:

- LoRA (Low-Rank Adaptation): introduce ajustes ligeros sobre los pesos del modelo.

- QLoRA: optimiza estos ajustes reduciendo el consumo de memoria.

- Prompt o Prefix Tuning: aprende representaciones adicionales que guían el comportamiento del modelo sin modificar sus pesos originales.

han hecho que el fine-tuning sea más accesible sin necesidad de grandes infraestructuras.

Qué problema resuelve realmente (y qué no)

El valor del fine-tuning no está tanto en “añadir conocimiento”, sino en hacer que el modelo sea consistente y predecible dentro de un proceso.

Por ejemplo, permite:

- Responder con una estructura definida.

- Mantener un tono corporativo consistente.

- Reducir la variabilidad en respuestas similares.

Esto es clave en entornos empresariales, donde la fiabilidad es tan importante como la capacidad de generación. Sin embargo, el fine-tuning tiene límites.

No es la mejor opción para gestionar información que cambia con frecuencia ni sustituye una arquitectura sólida. En esos casos, es más adecuado utilizar RAG, que permite trabajar con datos actualizados en tiempo real.

RAG aporta conocimiento actualizado; el fine-tuning optimiza principalmente el comportamiento y la especialización de la tarea.

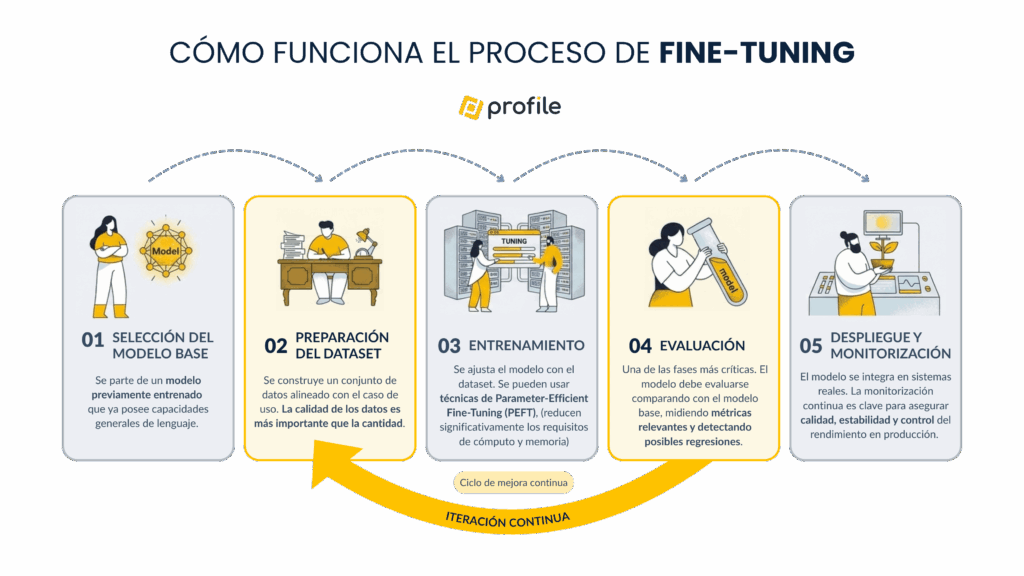

Cómo funciona el proceso de Fine-Tuning

Aunque suele presentarse como un flujo lineal, en la práctica el fine-tuning es un proceso iterativo basado en evaluación continua. En la práctica, el ciclo real suele ser: entrenar, evaluar, ajustar datos y volver a entrenar.

Prompt Engineering, RAG o Fine-Tuning: cómo decidir

En la práctica, no son enfoques excluyentes. De hecho, en muchas arquitecturas modernas, prompting, RAG y fine-tuning se combinan.

Como regla general:

- El prompt engineering es ideal para exploración y prototipos, por su rapidez y bajo coste inicial.

- RAG es especialmente útil cuando el valor depende de información actualizada, documental o trazable.

- El fine-tuning cobra más sentido cuando se busca un comportamiento consistente, especializado y repetible.

Cuándo tiene sentido aplicar Fine-Tuning

- Cuando la tarea está bien definida: Si aún se está explorando el problema, probablemente es pronto para entrenar. El fine-tuning aporta más valor cuando el caso de uso ya está razonablemente maduro.

- Cuando necesitas consistencia: Especialmente en entornos regulados o procesos críticos, donde no basta con que el modelo acierte a menudo; hace falta que responda de forma uniforme y predecible.

- Cuando los prompts se vuelven complejos: Si el sistema depende de instrucciones largas, frágiles o difíciles de mantener, puede ser más eficiente trasladar parte de ese comportamiento al modelo ajustado.

- Cuando hay volumen y repetición: En escenarios de alto uso, puede mejorar la eficiencia operativa y, en algunos casos, reducir latencia o simplificar el uso del modelo, siempre que el coste global de entrenamiento y mantenimiento esté justificado.

Ejemplos de uso empresarial

El fine-tuning no suele aplicarse de forma aislada, sino como parte de una arquitectura más amplia. Aun así, hay escenarios donde su valor es especialmente claro.

Clasificación y transformación documental

En sectores como banca, seguros o legal, el fine-tuning puede utilizarse para que el modelo clasifique automáticamente documentos entrantes y extraiga siempre la misma información clave. Por ejemplo, una aseguradora podría ajustar un modelo para distinguir entre partes de siniestro, informes periciales y documentación médica, y devolver siempre campos concretos como número de expediente, fecha, tipo de incidencia y estado del caso. Aquí el valor no está solo en entender texto, sino en hacerlo de forma consistente, repetible y útil para un proceso operativo.

Generación de contenido con estilo controlado

También puede emplearse para asegurar consistencia en la generación de contenido a gran escala. Por ejemplo, una empresa puede ajustar un modelo para que genere descripciones de productos o comunicaciones internas siguiendo siempre el mismo tono, estructura y formato, independientemente del volumen o del equipo que lo utilice.

Copilots internos con comportamiento predecible

En asistentes para empleados, permite reducir ambigüedad y garantizar respuestas alineadas con procesos internos. Por ejemplo, un copiloto puede guiar a un empleado paso a paso en la gestión de un siniestro o una solicitud, asegurando que siempre siga el mismo flujo y proporcione respuestas consistentes según las políticas de la organización.

Coste técnico y trade-offs

Aunque el fine-tuning puede mejorar significativamente el rendimiento en ciertos casos, también introduce complejidad adicional.

Por un lado, implica preparación y curación de datos, entrenamiento y validación, evaluación continua, además de mantenimiento y versionado del modelo. Por otro, hoy existen técnicas que reducen ese esfuerzo frente al ajuste completo. En lugar de modificar todos los parámetros del modelo, muchas organizaciones utilizan enfoques como LoRA, QLoRA o PEFT para adaptar solo una parte del sistema con menores requisitos de cómputo y memoria.

Aun así, el punto clave no es solo el coste de entrenamiento, sino el ciclo completo: entrenar, evaluar, iterar y mantener el modelo en producción. Por eso, el fine-tuning debe entenderse como una inversión estratégica, no como una optimización puntual.

Conclusión

El fine-tuning es una herramienta muy valiosa para especializar modelos de IA, pero no debería entenderse como el punto de partida por defecto. Su verdadero valor aparece cuando el caso de uso ya está claro, el comportamiento que se quiere optimizar está bien definido y existen datos de calidad para entrenar y evaluar con criterio.

En la práctica, prompting, RAG y fine-tuning no compiten, sino que se combinan dentro de una misma arquitectura de IA.

En términos prácticos, una buena decisión arquitectónica suele empezar por esta pregunta: ¿necesitamos que el modelo sepa más o que se comporte mejor? Si el reto principal es acceder a información actualizada y propia, RAG suele ser la mejor ruta. Si el reto es consistencia, formato, tono o especialización operativa, entonces el fine-tuning puede ser la palanca adecuada.

Bien aplicado, el fine-tuning no solo mejora modelos: ayuda a convertir capacidades generales de IA en soluciones más útiles, más eficientes y más alineadas con la realidad del negocio.